『機械学習システムセキュリティガイドライン Version 2.00』を読む【I-6. 実際の機械学習システムに対する脅威分析・対策】

前回に引き続き、日本ソフトウェア科学会機械学習工学研究会から2023年9月に公開された『機械学習システム セキュリティガイドライン Version 2.00』を数回に分けて、自分なりにゆっくり読み解いていきたいと思います。

今回は、『本編』の「I-6. 実際の機械学習システムに対する脅威分析・対策」を読み解きました。

AIの開発や運用、サービス提供を行う皆さんの参考になる情報をご提供できればと思います。

また、G検定でも時事的な法律や制度などの問題も出題されているということなので、受験される方の何かの参考になれれば幸いです。

【目次】

1.ガイドライン全体の構成

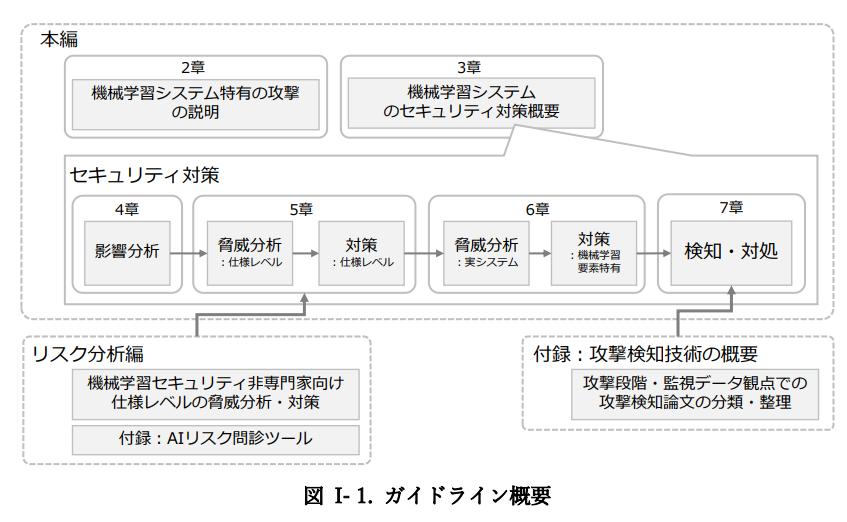

『機械学習システムセキュリティガイドライン Version 2.00』は、付録も含めて、大きく三つに分かれています。機械学習システム特有の攻撃とその対策を説明した『本編』と、機械学習セキュリティの非専門家に向けた脅威分析・対策を記載した『リスク分析編』と、付録の『攻撃検知技術の概要』になります。

出所:機械学習システムセキュリティガイドライン Part I.「本編」

ページ[I-1]

「I-1. ガイドライン概要」「I-2. 機械学習システム特有の攻撃」「I-3. 機械学習システムのセキュリティ」「I-4. 影響分析」「I-5. システム仕様レベルでの脅威分析・対策」については、以下で記事にしておりますので、ご参照ください。

『機械学習システムセキュリティガイドライン Version 2.00』を読む【まとめ】

2.今回読んだ範囲の概要

今回は、『本編』の「I-6. 実際の機械学習システムに対する脅威分析・対策」を読み解きました。

「実モデルに対する脅威分析」、「機械学習要素特有の対策」について記載されています。

3.「I-6.1. 実モデルに対する脅威分析」を読み解く

ここでは、機械学習システムに特有の脅威を引き起こす攻撃に焦点を当て、その攻撃が実際に対象の機械学習システムで成立する可能性を評価することに言及されています。手順としては以下の通りです。

- 攻撃手法の選定において、対象の機械学習システムの機械学習アルゴリズムや扱うデータの種類を考慮し、発表論文などから適用可能な具体的な攻撃手法を抽出します。

- 攻撃手法は攻撃者の知識や攻撃対象によって異なるため、対象に適した攻撃手法を選びます。

- 選ばれた攻撃手法を実装できる度合、攻撃の成功度合いを評価します。

この評価の際に役立つAdversarial Robustness Toolbox(ART)、CleverHans、Counterfitなどのツールも紹介されています。これらのツールは以下の表にまとめられ、対応するフレームワークや使いやすさ、実装されている攻撃手法などから、目的に合ったツールを選択することが重要とされています。

| Library | Framework | License | URL |

|---|---|---|---|

| CleverHans | JAX, PyTorch, TF2 | MIT license | https://github.com/cleverhans-lab/cleverhans |

| ART | TF, Keras, PyTorch, MXNet, scikit-learn, XGBoost, LightGBM, CatBoost, GPy, etc. | MIT license | https://adversarial-robustness-toolbox.readthedocs.io/en/latest/ |

| Foolbox | PyTorch, JAX, TF | MIT license | https://foolbox.readthedocs.io/en/stable/ |

| AdverTorch | PyTorch | LGPL-3.0, GPL-3.0 licenses found | https://github.com/BorealisAI/advertorch |

| AdvBox |

PaddlePaddle, PyTorch, Caffe2,MxNet, Keras, TF |

Apache-2.0 license | https://github.com/advboxes/AdvBox |

| DEEPSEC |

PyTorch

|

MIT License |

4.「I-6.2. 機械学習要素特有の対策」を読み解く

前述の実モデルに対する脅威分析の結果、緩和策の実施の例が以下のように紹介されています。緩和策実施後は、再度 I-6.1 節の脅威分析を行い、効果を評価・確認するよう記載されています。

出所:機械学習システムセキュリティガイドライン Part I.「本編」

ページ[I-24]

5.おわりに

今回は、『機械学習システム セキュリティガイドライン Version 2.00』の『本編』の「I-6. 実際の機械学習システムに対する脅威分析・対策」を読み解いてきました。

実モデルに対する脅威分析では、評価の際に役立つツールの紹介がされています。まだ使ったことがないので、これから試していきたいと思います。

また、対策についてはそれぞれの攻撃に対して緩和策の例が示されており、参考になりました。しかしながら、あくまでも緩和策なので複数の対策を組み合わせて使っていく必要があると思いました。

次回は「I-7. 検知・対処」を読み解いていきたいと思います。