今回から、12月21日に開催された第7回AI戦略会議で総務省、経済産業省の連名で報告された『AI事業者ガイドライン案』を数回に分けて、自分なりにゆっくり読み解いていきたいと思います。

今回は、ガイドラインの用語の定義を中心とした「第1部 AIとは」を読み解きました。

AIの開発や運用、サービス提供を行う皆さんの参考になる情報をご提供できればと思います。

これまでに、読み解いた章については、以下に公開しておりますので、併せてご参照ください。

oregin-ai.hatenablog.com

また、G検定でも時事的な法律や制度などの問題も出題されているということなので、受験される方の何かの参考になれれば幸いです。

【目次】

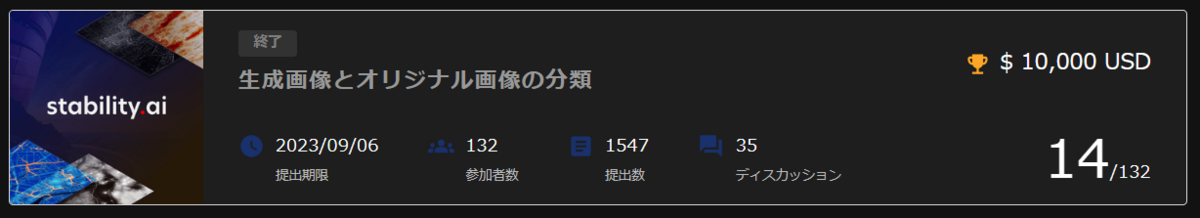

『AI事業者ガイドライン案』は、別添(付属資料)付録も含めて、大きく5つに分かれています。ガイドラインの用語の定義を中心とした「第1部」、AIの社会的な利用に関する基本理念と指針をまとめAIの利益と社会的リスクへのガバナンス構築の必要性をすべての事業者向けに記載した「第2部」、AIを活用するAI開発者、AI提供者、AI利用者の3主体の留意事項を記載した「第3部」、「第4部」、「第5部」で構成されています。

また、各主体は自身の記載箇所だけでなく、隣接主体に関する事項にも理解を広げることが重要だとされています。

出所:AI事業者ガイドライン案

ページ6

2.今回読んだ範囲の概要

今回は、ガイドラインの用語の定義を中心とした「第1部 AIとは」を読み解きました。

AIのなりたちや概念を説明したあと関連する用語が定義されています。

3.AIのなりたちや概念を読み解く

冒頭にAIのなりたちや概念が記載されています。

1956年にダートマス会議で初めて使用されましたが、確立された定義はなく、人間の思考に似たコンピュータプログラムや知的な判断ができるシステムを指す言葉とされています。

機械学習やディープラーニングの発展により、特定の分野に特化せず、汎用的なAIの開発が進んでいることからも、「AI」といっても、種類が多岐にわたっており、今後のAI技術のあり方について専門家でも予測が困難であるとされています。

このような状況を踏まえ、ガイドライン上の認識を統一するために用語が定義されています。

4.関連する用語の定義を読み解く

このガイドラインは、以下の通り、用語が定義されています。

- AI

現時点で確立された定義はなく(統合イノベーション戦略推進会議決定 「人間中心の AI 社会原則」(2019 年 3 月 29 日))、広義の人工知能の外延を厳密に定義することは困難である。本ガイドラインにおける AI は「AI システム」自体や、機械学習をするソフトウ アやプロ ラムを含む抽象的な概念とする。

(参考として JIS X22989 では ISO/IEC22989 に基づき、以下のように定義されている)

<学問分野>AI システムのメカニズム及び適用の研究開発

注釈 1. 研究開発は、コンピュータサイエンス、データサイエンス、自然科学、人文科学、数学等、幾つもの分野にわたって行うことが可能である

- AIシステム

活用の過程を通じて様々なレベルの自律性をもって動作し学習する機能を有するソフトウ アを要素として含むシステムとする(機械、ロボット、クラウドシステム等)。

(参考として JIS X22989 では ISO/IEC22989 に基づき、以下のように定義されている)

人間が定義した所与の目標の集合に対して、コンテンツ、予測、推奨、意思決定等の出力を生成する工学的システム

注釈 1. 工学的システムは、人工知能に関連する様々な技法及びアプローチを使用して、作業の実施に使用可能であるデータ、知識、プロセス等を表すモデルを開発することが可能である

注釈 2. AI システムは、様々な自動化のレベルで動作するように設計されている

(参考として OECD AI Principles overview では以下のように定義されている)

AI システムは、明示的または暗黙的な目的のために推測するマシンベースのシステムである。受け取った入力から、物理環境または 想環境に影響を与える可能性のある予測、コンテンツ、推奨、意思決定等の出力を生成する。AI システムが異なれば、導入後の自律性と適応性のレベルも異なる

- 高度 AI システム

最先端の基盤モデル及び生成 AI システムを含む、最も高度な AI システムを指す。

- AI モデル (ML モデル )

AI システムに含まれ、学習データを用いた機械学習によって得られるモデルで、入力データに応じた予測結果を生成する。

(参考として JIS X22989 では ISO/IEC22989 に基づき、以下のように定義されている)

入力データ又は情報に基づいて推論(inference)又は予測を生成する数学的構造

例 : 単変量線形関数 y=θ0+θ1x が、線形回帰を使用して訓練されている場合、結果のモデルは、y=3+7x のようになる

注釈 1. 機械学習モデルは、機械学習アルゴリズムに基づく訓練の結果として得られる

- AI サービス

「AI システム」を用いた役務を指す。利用者への価値提供の全般を指しており、AI サービスの提供・運は、AI システムの構成技術に限らず、人間によるモニタリン やステークホルダーとの適切なコミュニケーション等の非技術的アプローチも連携した形で実施される。

- 生成 AI

文章や画像、プロ ラム等を生成できる AI モデルに基づく AI の総称を指す。

- AI ガバナンス

AI の利活用によって生じるリスクをステークホルダーにとって受容可能な水準で管理しつつ、そこからもたらされる正のインパクトを最大化することを目的とする、ステークホルダーによる技術的、組織的、及び社会的システムの設計及び運用。

出所:AI事業者ガイドライン案

ページ8、ページ9

全体的に様々な定義を参照しつつ整合性が取れるよう少し抽象化された定義となっているように感じました。

しかしながら「AIシステム」について、「自立性をもって動作し学習する機能を有するソフトウェアを要素として含むシステム」と明記されていることで、システムの一部にでもAIが組み込まれていれば全て「AIシステム」として扱うことが明確になった点はわかりやすいと思います。

5.おわりに

今回は、『AI事業者ガイドライン案』の「第1部 AIとは」を読み解いてきました。

意外と認識されているようで曖昧になりがちな「AI」自体にさかのぼって定義されていることで、今後読み進めるガイドラインの対象がわかりやすくなりました。

また、今回定義されて終わりではなく、「はじめに」で言及されたように、Living DocumentとしてAIの動向や技術の進展に柔軟に改定されていくものと思われます。常に最新版を参照している必要がありそうです。

次回は、第2部「AI により目指すべき社会と各主体が取り組む事項」に読み進んでいきたいと思います。